Dando continuidade aos posts sobre o uso da inteligência artificial no mundo dos negócios, segue este conteúdo com foco em governança que enfatiza as questões relacionadas ao risco, além de apresentar nove passos no desenvolvimento de um modelo de IA.

A IA responsável atingiu o pico?

Não é segredo que a pandemia acelerou a adoção e, mais criticamente, o desejo das organizações de adotar recursos de inteligência artificial (IA). No entanto, é notavelmente difícil fazer a IA funcionar. Apenas 6% das organizações conseguiram operacionalizar a IA, de acordo com a recente pesquisa global de IA responsável da PwC com mais de 1.000 participantes de organizações líderes nos EUA, Reino Unido, Japão e Índia. Mais da metade das empresas na pesquisa disseram que ainda estão experimentando e não se comprometem com grandes investimentos em recursos de IA.

Mas as empresas que têm uma estratégia de IA incorporada podem implantar aplicativos em escala de maneira mais confiável, com adoção mais ampla em toda a empresa, do que aquelas que não têm. Empresas maiores (mais de US$ 1 bilhão), em particular, são significativamente mais propensas a explorar novos casos de uso para IA (39%), aumentando seu uso de IA (38%) e treinando funcionários para usar IA (35%).

IA responsável

Embora alguns desafios à operacionalização sejam técnicos ou limitados por conjuntos de habilidades, uma lacuna de confiança continua sendo um inibidor.

Uma grande tendência é incorporar práticas de “IA responsável” para preencher essa lacuna de confiança. A IA responsável compreende as ferramentas, processos e pessoas necessárias para controlar os sistemas de IA e governá-los adequadamente de acordo com o ambiente em que gostaríamos de operar e é implementado usando recursos técnicos e processuais para abordar preconceitos, explicabilidade, robustez, segurança e proteção preocupações (entre outras coisas). A intenção da IA responsável, que às vezes é chamada ou confundida com IA confiável, ética da IA ou IA benéfica, é desenvolver sistemas de IA e análise metodicamente, permitindo sistemas documentados e de alta qualidade que reflitam as crenças e valores de uma organização e minimizando danos não intencionais

IA responsável na empresa

A apreciação das novas preocupações que a IA pode representar para uma organização levou a um aumento significativo nas atividades de mitigação de riscos. As organizações estão buscando estratégias para mitigar os riscos de aplicativos individuais, bem como os riscos mais amplos impostos aos negócios ou à sociedade, que os clientes e os reguladores estão cada vez mais exigentes (Figura 1). Esses riscos são experimentados no nível do aplicativo, incluindo instabilidade de desempenho e viés na tomada de decisões de IA; o nível de negócios, como risco empresarial ou financeiro; e o nível nacional, como deslocamento de empregos da automação e desinformação. Para lidar com esses riscos e muito mais, as organizações estão usando uma variedade de medidas de mitigação de riscos, começando com medidas ad hoc e avançando para um processo de governança mais estruturado. Mais de um terço das empresas (37%) têm estratégias e políticas para lidar com o risco de IA, um forte aumento em relação a 2019 (18%).

[Figura 1 – Taxonomia do risco

Apesar dessa ênfase crescente na mitigação de riscos, as organizações ainda estão debatendo como governar a IA. Apenas 19% das empresas da pesquisa têm um processo formal documentado que é reportado a todos os stakeholders; 29% possuem um processo formal apenas para tratar de um evento específico; e o saldo tem apenas um processo informal ou nenhum processo claramente definido.

Parte dessa discrepância se deve à falta de clareza em torno da propriedade da governança da IA. A quem pertence este processo? Quais são as responsabilidades dos desenvolvedores, da função de conformidade ou gerenciamento de riscos e da auditoria interna?

Bancos e outras organizações já sujeitas à supervisão regulatória de seus algoritmos tendem a ter funções robustas (equipes de “segunda linha”) que podem validar modelos de forma independente. Outros, no entanto, precisam contar com equipes de desenvolvimento separadas, porque a segunda linha não possui as habilidades apropriadas para revisar sistemas de IA. Algumas dessas organizações estão optando por reforçar suas equipes de segunda linha com mais conhecimento técnico, enquanto outras estão criando diretrizes mais robustas para garantia de qualidade na primeira linha.

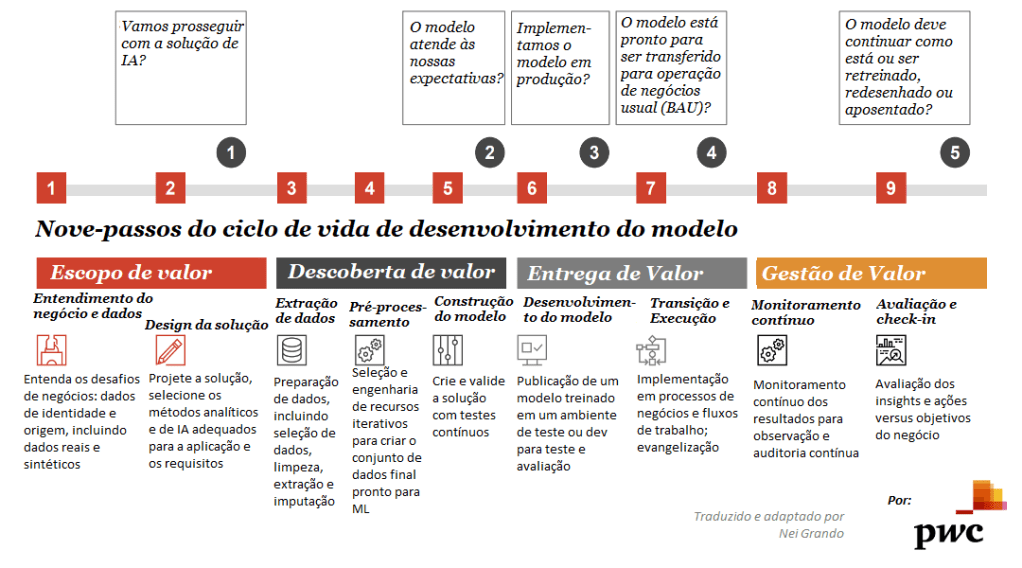

Independentemente da responsabilidade, as organizações exigem uma metodologia de desenvolvimento padrão, completa com estágios em pontos específicos, para permitir o desenvolvimento e monitoramento de IA de alta qualidade (Figura 2). Essa metodologia também se estende às equipes de compras, já que muitos sistemas de IA entram nas organizações por meio de um fornecedor ou plataforma de software.

Figura 2 – Estágios em um processo de desenvolvimento de um modelo em IA

A conscientização sobre os riscos da IA complementa outra tendência de considerar a ética da tecnologia – adotar práticas para desenvolvimento, aquisição, uso e monitoramento de IA orientados por uma mentalidade de “o que você deve fazer” em vez de “o que você pode fazer”.

Embora haja uma série de princípios éticos para IA, dados e tecnologia, a justiça continua sendo um princípio fundamental. Trinta e seis por cento dos entrevistados da pesquisa identificam o viés algorítmico como uma área de foco principal de risco e 56% acreditam que podem lidar adequadamente com os riscos de viés. À medida que as empresas amadurecem na adoção da IA, elas também tendem a adotar o viés algorítmico como foco principal, dada a experiência no desenvolvimento de IA e a conscientização sobre os problemas relacionados aos riscos da IA. A justiça é classificada como o quinto princípio mais importante para empresas maduras em IA versus estar em oitavo lugar para organizações menos maduras. Outros princípios incluem segurança, proteção, privacidade, responsabilidade, explicabilidade e agência humana. As abordagens organizacionais para implementar a IA e a ética de dados tendem a se concentrar em iniciativas restritas que são consideradas isoladamente e utilizam ferramentas pontuais, como avaliações de impacto e códigos de conduta. Grandes empresas com uso maduro de IA são significativamente mais propensas a investir em uma variedade de iniciativas, incluindo a realização de avaliações de impacto (62%), a criação de um conselho ético (60%) e o fornecimento de treinamento ético (47%). Esse impulso sinaliza um reconhecimento de que várias iniciativas internas seriam necessárias para operacionalizar a IA responsável.

O que as organizações podem fazer

Estabeleça princípios para orientar: Um conjunto de princípios éticos adotados e apoiados pela liderança fornece uma estrela norte para a organização. Os princípios por si só, no entanto, não são suficientes para incorporar práticas responsáveis de IA. As partes interessadas precisam considerar os princípios no contexto de seu trabalho diário para projetar políticas e práticas que toda a empresa possa apoiar.

Considere a propriedade da governança: Felizmente, muitos líderes nas organizações estão interessados em estabelecer práticas de governança para IA e dados. No entanto, sem especificar um proprietário para essa governança, é provável que uma organização se depare com um problema diferente – práticas discretas que podem estar em conflito umas com as outras. Identifique quais equipes devem projetar abordagens de governança e concorde com um proprietário e um processo para identificar atualizações nas políticas existentes.

Desenvolva um processo bem definido e integrado para dados, modelo e ciclo de vida de software: implemente processos padronizados para desenvolvimento e monitoramento, com etapas específicas para indicar onde as aprovações e revisões são necessárias para prosseguir (Figura 2). Esse processo deve se conectar aos mecanismos de governança de dados e privacidade existentes, bem como ao ciclo de vida de desenvolvimento de software.

Quebre os silos: alinhe os grupos de partes interessadas necessários para conectar as equipes com o objetivo de compartilhar ideias e práticas de liderança. Crie inventários comuns para IA e dados para o processo de governança e use este exercício como uma oportunidade para considerar mudanças estruturais ou realinhamentos que possam permitir que os negócios funcionem melhor.

Fique de olho no clima regulatório em rápida mudança: não são apenas clientes, investidores e funcionários que exigem práticas responsáveis. Os reguladores estão tomando conhecimento e propondo legislação nos níveis estadual, regulador, nacional e supranacional. Algumas regulamentações decorrem de esforços expandidos de proteção de dados e privacidade, algumas de reguladores específicos em áreas restritas de casos de uso (como bancos) e algumas de um desejo mais geral de melhorar a responsabilidade (como Estratégia Brasileira de Inteligência Artificial -EBIA- do MTIC e legislação atual sobre IA). Manter o ritmo dessas regulamentações é fundamental para identificar futuras atividades de conformidade.

Com essas ações, as organizações estarão melhor posicionadas para lidar com os riscos de IA de maneira ágil.

Se gostou, por favor, compartilhe! Um abraço, @neigrando

Conte comigo em seus projetos. Sobre mim: aqui. Contato: aqui.

Referência

Este artigo trata-se da adaptação, redução e tradução, do artigo, em inglês, da Havard Business Review: “How Organizations Can Mitigate the Risks of AI“, pela PwC (2021).

Artigos relacionados

- Os 7 Padrões da Inteligência Artificial

- A adoção da Inteligência Artificial pelas Empresas (do relatório O’Reilly de 2022)

- Modelo de Maturidade de Inteligência Artificial (proposto pelo Gartner)

- Lista de artigos sobre IA para Negócios

- …